AI w rekrutacji - czy sztuczna inteligencja powinna rekrutować zamiast ludzi?

Rekruter człowiek vs Rekruter AI - kogo wybieram?

“Kandydat woli, gdy decyzja o jego zatrudnieniu podejmowana jest przez człowieka, a nie przez sztuczną inteligencję”- przeczytałem kiedyś w jednym z komentarzy.

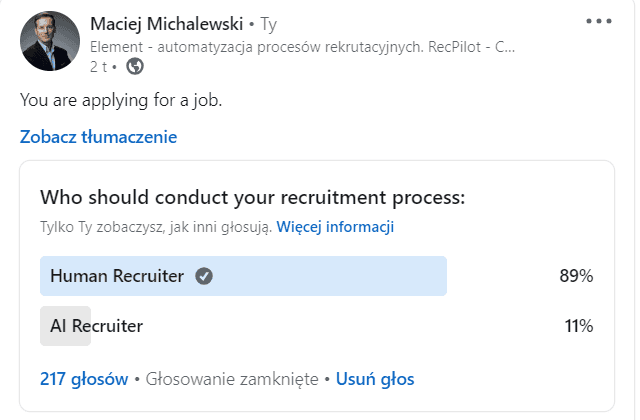

Kilka lat później zapytałem o to społeczność LinkedIn:

Wynik ankiety, jaki i wcześniej przytoczony komentarz, nie są zaskoczeniem. Rekrutacja to jeden z tych procesów zawodowego życia, który nieodłącznie kojarzy się z bezpośrednią rozmową między ludźmi. Oczywiście nie chodzi tylko o utarty zwyczaj rozmów pomiędzy kandydatem i rekruterem, ale także o konkretne, praktyczne powody, dla których wybór ludzkiego rekrutera jest naturalny. Te praktyczne powody to przede wszystkim następujące fakty.

- Rozmowa między ludźmi budzi emocje. Emocje stanowią esencję komunikacji międzyludzkiej.

- Bezpośredni kontakt z inną osobą i wspomniane wyżej emocje, pozwalają na budowanie relacji.

- Człowiek lepiej interpretuje niuanse komunikacji, takie jak ton głosu, mowa ciała, intencje, co może wpłynąć na ocenę kandydata i rekrutera.

- Kandydaci mogą czuć się bardziej komfortowo wyrażając swoje obawy i pytania człowiekowi, w szczególności, jeśli w toku rozmowy wywiązała się już nic porozumienia i zaufania.

Wstrząsające wyniki badań ludzkich osądów

W jednym z odcinków World Science Festival, o znamiennym tytule Outsourcing Humanity, omawiano postępy w rozwoju sztucznej inteligencji. Przedstawiono sukcesy i porażki, które pojawiają się w toku rozwoju tej technologii. Wśród sukcesów znalazły się m.in. obiecujące wyniki z zakresu wykrywalności raka piersi. Wśród porażek, spektakularne fiasco sztucznej inteligencji, testowanej w procesach rekrutacyjnych Amazon.

Porażka Amazon wynikała z faktu zastosowania nieprawidłowo przygotowanych danych do nauki procesu podejmowania decyzji. Dane te pochodziły z historycznych procesów rekrutacyjnych, w których preferowanymi kandydatami byli kandydaci płci męskiej. Algorytm, ucząc się na takich danych, również preferował mężczyzn, co szybko wyszło na jaw i przerodziło się w głośną porażkę.

Moją szczególną uwagę zwrócił jednak przypadek zupełnie innej porażki, niezwiązanej bezpośrednio ze sztuczną inteligencją. Przypadek, którego analiza może wstrząsnąć wiarą w ludzki osąd, pochodzi z obszaru, który powinien być ostoją najbardziej trafnych decyzji, tj. z wymiaru sprawiedliwości.

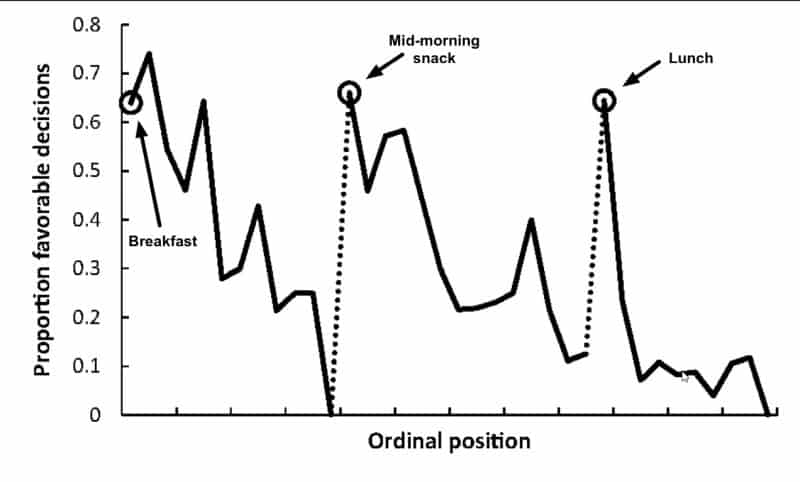

W 2011 r. ukazało się badanie Amerykańskiej Akademii Nauk, w której ujawniono dość szokujące wyniki analizy orzeczeń sądowych w sprawach zwolnień warunkowych. Przebadano ponad 1000 orzeczeń wydanych w ciągu 10 miesięcy przez 8 doświadczonych sędziów. Z przeprowadzonych badań wynika, że najwyższe prawdopodobieństwo (65%) na uzyskanie pozytywnego rozstrzygnięcia sądu istniało tuż po… śniadaniu (nie, to nie jest dowcip!). Prawdopodobieństwo to następnie stale malało i przed kolejnym posiłkiem było niemal równe zeru. Wynik badań prezentuje poniższy wykres:

Jak widać, przed przerwą na “drugie śniadanie” oraz lunch, szansa na pozytywne rozstrzygnięcie sądu jest nikła. Tuż po posiłku szansa osiąga swój maksymalny poziom. Nie dałbym wiary tym badaniom, gdybym nie zobaczył ich w wiarygodnym programie naukowym, a następnie nie dotarłbym do źródeł w Amerykańskiej Akademii Nauk (https://www.pnas.org/content/108/17/6889.full). W konkluzji badania pojawiło się następujące stwierdzenie:

“Indeed, the caricature that justice is what the judge ate for breakfast might be an appropriate caricature for human decisionmaking in general.”

Ludzki pierwiastek szansą i zagrożeniem

Wyniki badania orzeczeń sądowych są szokujące. Wykorzystuję powyższy wykres na prelekcjach i szkoleniach z obszaru AI, by pokazać, że zaufanie do ludzkich decyzji powinno mieć swoje granice. Granice tego zaufania powinny być – przynajmniej w niektórych przypadkach – wyznaczone bardzo ostrożnie.

Sztuczna inteligencja oprócz swoich niedoskonałości oferuje wiele korzyści. Jedną z tych korzyści jest podejmowanie decyzji opierając się na suchych faktach. W pewnym sensie brak emocji, czyli pierwiastka człowieczeństwa, jest w tym przypadku atutem AI. Nie czując sympatii, złości, zniecierpliwienia czy irytacji, AI podejmuje decyzje oparte o czystą kalkulację danych, co z pewnością wpływa pozytywnie na obiektywizm tych decyzji.

Oczywiście tragicznych przykładów ludzkiej niedoskonałości jest znacznie więcej, niż tylko szokujący raport o orzeczeniach sądowych. Najlepszym jest pewnie prowadzenie samochodu w stanie nietrzeźwym bądź też nawet pod wpływem dużego zmęczenia. Tu również mamy odpowiedź technologii – np. sztuczna inteligencja w samochodach Tesli.

To przeciwstawianie przykładów ludzkiej niedoskonałości i technicznych możliwości ma pokazać, jak dobrym wsparciem może być dla nas AI. Sztuczna inteligencja może eliminować ludzkie błędy i słabości i niwelować wpływ na nasze działanie takich czynników, jak zmęczenie, głód, zdenerwowanie, strach czy nagromadzony stres.

Ludzie oferują obecnie coś, czego technologia dać jeszcze nie może – emocje. Technologia daje zaś nam matematyczną dokładność. To do nas należ obowiązek mądrego łączenia tych wartości i w tym mądrym połączeniu upatruje szansę, na lepszą przyszłość.

—

Najczęściej czytane:

- Darmowe ogłoszenia o pracę i największa lista źródeł kandydatów – największa w Polsce lista bezpłatnych i płatnych źródeł kandydatów

- Job Monit HR – wynagrodzenia i oferty pracy w HR

- Akademia Rekrutacji – zbiór wiedzy na temat rekrutacji oraz raporty z rynku pracy.

- Gowork – jak reagować na negatywne opinie o pracodawcach – Kompleksowy poradnik dla pracodawców.

- Sztuczna inteligencja w rekrutacji i Chat GPT-3 – wszystko co musisz wiedzieć o najnowszej wersji sztucznej inteligencji i jej możliwych zastosowaniach, także w rekrutacji.

- RODO w rekrutacji – sourcing, direct search, ogłoszenia. Wszystko co musisz wiedzieć – kompleksowy poradnik RODO w rekrutacji z naciskiem na działania typu direct search / sourcing.

- Wszystko o systemach ATS – poradnik wyboru systemu rekrutacyjnego

Nasze artykuły przeczytasz także na Medium, Hashnode, Reddit, Substack.

Podobne biasy pojawiają się w rekrutacji — dlatego ankieta 8724 kandydatów ujawnia systemowe problemy w procesach rekrutacyjnych.

Maciej Michalewski

CEO @ Element. Recruitment Automation Software

Ostatnie wpisy:

Element ma API: rekrutacja podłączona do twoich systemów

Element ma publiczne API w wersji v1-beta. Pokazuję, co integracje dają klientom systemu rekrutacyjnego, jakie błędy popełniłem i czego mnie nauczyły.

Rekrutacja na telefonie: Element jest już mobilny dzięki AI

Mobilne widoki Elementu są na produkcji. Rekruterzy i hiring managerowie prowadzą proces ze smartfona, a 15 000 linii kodu napisało AI w pięć tygodni.

Otrzymujesz email od AI zamiast od człowieka – problem?

Email od AI to nic złego, o ile dane są dobrej jakości. Większość rutynowych zadań ma charakter algorytmiczny, a wynik liczy się bardziej niż autorstwo wiadomości.

Raport ofert pracy, kwiecień 2026: rynek odbija od dna

W kwietniu 2026 pojawiło się 265 tys. ofert pracy w Polsce, spadek tylko o 1% r/r jest najmniejszy od 10 miesięcy. Pobierz LXXI edycję raportu GT i Element.

AI nie zabiera pracy, twierdzi a16z. Co na to polski rynek

David George z a16z dowodzi, że apokalipsa AI to fantazja. Konfrontuję jego argumenty z polskimi danymi i moimi wcześniejszymi tezami.

Integracja Element z LinkedIn uruchomiona, podsumowanie projektu

LinkedIn zaakceptował publiczny feed XML Elementu, w pełni zbudowany w trybie vibe coding z Claude Code. Co z tego wynika dla osób, które nie kodują.