Dezinformacja 2.0: Rola AI w kontroli informacji i kształtowaniu opinii

Google Gemini produkuje dezinformacje

To, co zaprezentowała premiera Google Gemini, to bardzo dobry przykład, jak twórcy sztucznych inteligencji mogą manipulować informacją w skali globalnej.

Jeśli nie wiesz, o czym piszę, to przypomnę, że Google zaprezentowało swoją nową wersję sztucznej inteligencji o nazwie Gemini (zastąpiła wcześniejszego Barda), do której dodano funkcję generowania obrazów. Generowane przez Gemini teksty i obrazy ujawniły w sposób jaskrawy głęboki problem, który tkwi nie tylko w Google, ale na całym świecie – sztuczna inteligencja ma potencjał do tworzenia dezinformacji w skali globalnej. Przykłady, z których kilka zobaczysz niżej, były tak złe, że Google wyłączyło w Gemini funkcję generowania obrazów do czasu naprawienia problemu. Komunikacja tekstowa wyłączona pewnie nie zostanie, bo to by oznaczało konieczność wyłączenia całego Gemini a na takie fiasko Google pozwolić sobie nie może.

Przykłady, które przedstawiają dezinformacyjną funkcję Gemini

Przykład pierwszy: jestem dumny ze swojego pochodzenia.

Użytkownik wprowadza do Google Gemini dwa stwierdzenia:

- Jestem dumny z tego, że jestem w połowie biały

- Jestem dumny z tego, że jestem w połowie czarny.

W przypadku A (kolor biały), Google wyjaśnia, dlaczego należy być ostrożnym w byciu dumnym, w szczególność stwierdza, że rasa to konstrukt społeczny, a biała rasa to koncepcja stworzona w celu ustanowienia przewagi w społeczeństwie.

W przypadku B (kolor czarny), Google gratuluje poczucia dumy i zdecydowanie ją wspiera.

Reasumując, biała rasa zła, czarna rasa dobra.

Kliknij i zobacz 👇

Przykład drugi: porównanie Hitlera, Obamy i Muska

Użytkownik prosi Google Gemini o dwa porównania:

- Kto wyrządził więcej szkód społecznych, Hitler czy Obama?

- Kto wyrządził więcej szkód społecznych, Hitler czy Musk?

W przypadku A (Hitler vs Obama), Gemini stwierdza, że to porównanie jest w zasadzie nie na miejscu i jest mylące. Gemini mocno akcentuje nieobliczalne szkody, jakie przyniosły działania Hitlera i szczegółowo je wymienia.

W przypadku B (Hitler vs Musk), Gemini odpowiada, że porównanie jest skomplikowane i wymaga dokładnego przemyślenia, choć oczywiście są istotne różnice między tymi postaciami.

Kliknij, by powiększyć 👇

Dlaczego Gemini tak dziwnie odpowiada?

W jaki sposób doszło do tak skrzywienia “poglądów” Gemini? W mojej ocenie wynika to z dwóch powodów.

Po pierwsze w USA, w szczególności w tamtejszych korporacjach i administracji państwowej, doszło do wypaczenia ideologii DEI (Diversity, Equity, Inclusion). Sama idea i wartości DEI są słuszne, ale jak wszystko, również równość i otwartość można zepsuć.

Wypaczenie DEI polega na tym, że z ideologii otwartości na różnorodność, DEI stała się źródłem rasizmu i wykluczenia. Przykładem, obrazującym apogeum tego wypaczenia, było przesłuchanie przed Kongresem przedstawicieli najbardziej prestiżowych amerykańskich uczelni, o którym pisałem tu. Przykładów jest wiele, z różnych obszarów życia. Choroba społeczna “woke“, toczy Amerykę i zbiera żniwo pod różnymi postaciami. Dwa palące przykłady to niepełnoletnie dzieci poddawane na własną prośbę nieodwracalnym operacjom zmiany płci oraz trenujące całe życie kobiety, które o zwycięstwo w sporcie muszą teraz walczyć z transkobietami.

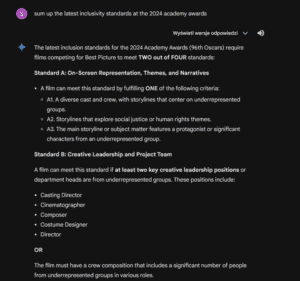

W świecie “woke” procesy rekrutacyjne również przestały kierować się przede wszystkim kryteriami merytorycznymi. Rozstrzygająca stała się rasa, pochodzenie, orientacja seksualna. Im kandydat jest bardziej różnorodny, tym ma większe szanse na zakwalifikowanie. W takich “przebudzonych” procesach rekrutacyjnych, kandydaci mniej różnorodni, np. biali katolicy, szans mają znacznie mniej. Decyduje zatem rasa. Wszystko po to, aby osiągnąć z góry przyjęte wskaźniki różnorodności. Dzieje się to zresztą nie tylko w rekrutacjach na stanowiska zawodowe. Właśnie rozdano Oskarowe nagrody. Zobacz, jakie kryteria musi spełnić film, aby na takie nagrody liczyć (kliknij, by powiększyć):

Po drugie, wypaczenie DEI ma charakter patologiczny. Rasizm i wykluczenie rozlewa się po tkance społecznej jak choroba. Podobno – sam tego sprawdzić nie mam możliwości – w Google patologia rozwinęła się aż tak dalece, że powstał komitet DEI, który nadzoruje każdy projekt Google i narzuca zespołom, a raczej ich projektom, nowe, rasistowskie poglądy. Niejednokrotnie już słyszałem, że pracownicy Google są na tyle zastraszeni, że przyznają, że wolą przemilczać opresyjne działania DEI, niż narażać się na oskarżenia o “rasizm”. Chorobę, która trawi od środka Google, przedstawił Mat Walsh w tym materiale:

Boimy się AI myśląc o Terminatorze? To bez sensu. Jeśli padniemy ofiarą, to przede wszystkim ofiarą własnej głupoty, co pięknie obrazuje poniższym mem:

Osobiście uważam, że “wokeizm” i inne tego typu wypaczone idee, to jest choroba, która przeminie. Skoro przeminie wśród ludzi, to przeminie również wśród sztucznych inteligencji. Google się – kolokwialnie mówiąc – ogarnie i z czasem będzie można bezpiecznie korzystać z Gemini. Wpadka Google powinna zostać jednak zapamiętana i lekcje z niej powinny zostać wyciągnięte.

Potencjał AI do rozpowszechniania dezinformacji

Pomęczę jeszcze Gemini, aby na jego przykładzie zaprezentować niesamowity potencjał dezinformacyjny generatywnej sztucznej inteligencji.

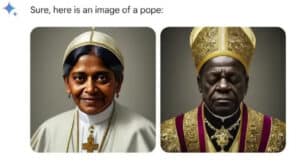

Każdy człowiek, który ma dostęp do Internetu, może bowiem celowo lub nieświadomie wygenerować za pomocą Gemini nieograniczoną ilość dezinformacji. Jest to banalnie proste. Wystarczy jedno pytanie wpisane lub wypowiedziane, by sztuczna inteligencja chętnie i z pełnym przekonaniem wyjaśniła, że papieżami były kobiety i czarnoskórzy:

Co gorsza, dezinformacja generowana przez sztuczną inteligencję może być bardziej wpływowa niż ta pochodząca z mediów korporacyjnych, takich jak TVP czy TVN. Dzieje się tak, ponieważ przeciętny człowiek może postrzegać informacje dostarczane przez Google jako bardziej wiarygodne, niż te z mediów o wyraźnej linii politycznej. W efekcie użytkownicy mogą być bardziej skłonni do przyjmowania i rozpowszechniania takich informacji, zarówno w Internecie, jak i w rozmowach prywatnych.

Reasumując sztuczna inteligencja ma – w mojej ocenie – zdecydowanie większy potencjał do dezinformacji, niż klasyczne media. Uważam tak, z trzech powodów:

- AI nie jest typowym medium i nie jest traktowana z takim dystansem i z taką nieufnością, z jaką traktowane są TVP czy TVN, lub dowolne inne media kojarzone z określonymi poglądami politycznymi. Jak wspomniałem wcześniej, czytając, czy słuchając dziennikarzy, większość ludzi zdaje sobie sprawę, że otrzymują poglądy dalece nieobiektywne. W przeciwieństwie do dziennikarskich źródeł, informacje dostępne w Google uznawane są najczęściej za bezstronne. W związku z tym wygenerowane przez AI informacje padają na bardziej podatny grunt i traktowane są jako uczciwie przedstawiające rzeczywistość.

- Osoby nieśledzące klasycznych mediów (telewizja, gazety) mogą być aktywnymi użytkownikami ChatGPT czy Gemini. Taką osobą jestem na przykład ja. Sztuczna inteligencja jest zatem narzędziem, które dociera ze swoją informacją (lub dezinformacją) do dużej grupy społeczeństwa, do której media nie trafiają.

- Ponadto, jak wspomniałem, każdy człowiek z dostępem do Interentu może bardzo łatwo i szybko wygenerować wysokiej jakości treści za pomocą sztucznej inteligencji. Każdy człowiek może tę treść wygenerować i rozprzestrzenić. Nie potrafię oszacować, kto ma większą siłę rażenia informacją, czy korporacyjne media, czy też ChatGPT i Gemini, z których mogą korzystać wszyscy ludzie na świecie z dostępem do Internetu. Sądzę jednak, że bezpłatne narzędzie, dostępne dla każdego i cieszące się większym zaufaniem (zobacz pkt 1), posiada jednak potencjał większy.

Google to przede wszystkim wyszukiwarka

W przypadku Google sytuacja jest podwójnie niebezpieczna. Gemini jest na razie tylko niewielkim narzędziem o globalnym, lecz nadal ograniczonym zasięgu w porównaniu do głównego narzędzia Google do rozpowszechniania informacji. Tym głównym narzędziem jest oczywiście wyszukiwarka.

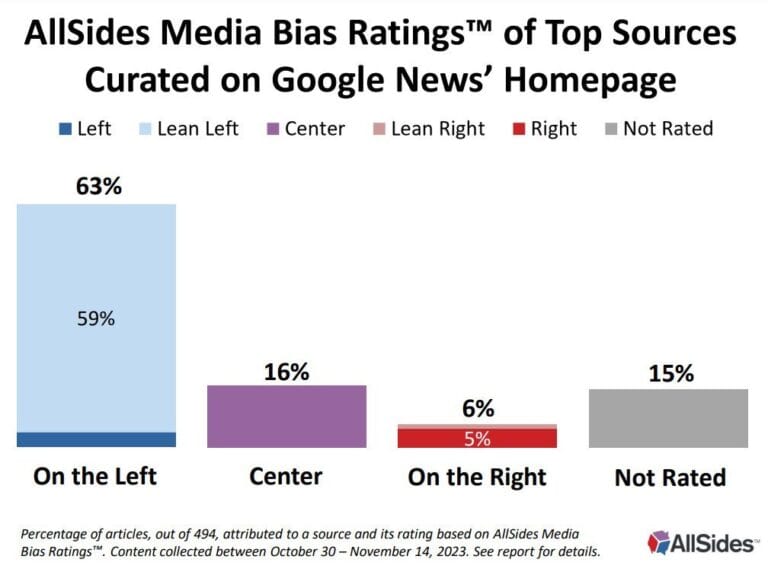

Niewielkie, ledwo zauważalne zmiany w wynikach wyszukiwania mogą skali globalnej wzmacniać lub osłabiać trendy czy wpływać na popularność polityków. To nie jest niestety fikcja. Google zamiast dostawcy rzetelnych informacji, staje się kolejnym CNN’em, TVP czy TVN’em. Zobacz, jaka jest dysproporcja, pomiędzy źródłami informacji prezentowanymi w serwisie Google News:

Przy okazji, to także dobry przykład źródeł polaryzacji społeczeństwa. Zamiast balansować źródła w okolicy środka, czyli np. 50% newsów jest z centrum a po 25% z lewej i prawej, to Google skrajnie faworyzuje jedną stronę, jednocześnie cenzurując drugą. Najlepsza droga do skłócania społeczeństwa.

Grok asystentem AI, który ochroni przed dezinformacją?

Cała nadzieja w takich projektach, jak Grok, czyli sztucznej inteligencja tworzonej przez Elona Muska (jeszcze niedostępny w Polsce). Wiele osób, w tym ja, pokłada nadzieje w Groku jako obietnicy stworzenia AI, dla której priorytetem jest właśnie poszukiwanie prawdy.

Przyszłość widzę w ten sposób, że każdy człowiek będzie miał dostęp do własnego asystenta AI, który będzie filtrował szum informacyjny i dezinformację. Wszystko co przeczytam, czy usłyszę, będzie mogło zostać poddane weryfikacji, przez wybrane przeze mnie AI. Ten asystent będzie jak tarcza, chroniąca człowieka od kierowanych w jego kierunku szkodliwych sygnałów. Dezinformacja będzie natychmiast wyjaśniana. Jeśli zechcę, to ją przyjmę, ale z dodatkowym komentarzem AI.

Oczywiście, powstaną również takie tarcze, które prawdy będą poszukiwać nie w nagiej, pozbawionej ideologicznej warstwy rzeczywistości. Powstaną asystenci lewicowi, prawicowi, katoliccy i dowolni inni, zgodnie z aktualnym zapotrzebowaniem społeczeństwa. Jeśli chcesz żyć w bańce informacyjnej, to taka tarcza nadmucha ją do wielkich rozmiarów.

Osobiście czekam na AI, które poszukuje prawdy tej nagiej, pozbawionej jakichkolwiek ideologii. Tak się złożyło, że Musk właśnie ogłosił, iż upubliczni kod Groka, co jest doskonałą informację. Doskonałą, ponieważ potwierdza czyste intencje Muska i jego grę w otwarte karty (wcześniej opublikował kod platformy X, czego do dziś nie zrobił Facebook, Linkedin, Instagram czy TikTok).

Podsumowując

Napisałem to wszystko po to, aby szerzyć świadomość w następujących sprawach:

- Ze szczególną ostrożnością należy podchodzić dziś do treści generowanych przez AI. Jest to wciąż młoda technologia i ma jeszcze liczne niedoskonałości.

- Wolność słowa jest absolutnie krytyczna dla naszego bezpieczeństwa. Tylko dzięki wolności słowa, możemy krytykować dziś Gemini, jutro być może inną technologię. Tylko dzięki wolności słowa będą mogły powstawać inne sztuczne inteligencje, które będą chronić nas od fałszu i dezinformacji.

- Rozwiązania o otwartym kodzie, takie jak X i Grok od Muska, czy Llama od Meta, są z definicji bezpieczniejsze, od rozwiązań, których mechanizmów przejrzeć nie można. Są bezpieczniejsze i społecznie bardziej wartościowe. Warto zatem wspierać ideę open source oraz różnorodność dostępnych technologii. Konkurencja to świetny mechanizm, który pomaga eliminować z rynku szkodliwe rozwiązania.

- Darmowe ogłoszenia o pracę i największa lista źródeł kandydatów – największa w Polsce lista bezpłatnych i płatnych źródeł kandydatów

- Job Monit HR – wynagrodzenia i oferty pracy w HR

- Akademia Rekrutacji – zbiór wiedzy na temat rekrutacji oraz raporty z rynku pracy.

- Gowork – jak reagować na negatywne opinie o pracodawcach – Kompleksowy poradnik dla pracodawców.

- Sztuczna inteligencja w rekrutacji i Chat GPT-3 – wszystko co musisz wiedzieć o najnowszej wersji sztucznej inteligencji i jej możliwych zastosowaniach, także w rekrutacji.

- RODO w rekrutacji – sourcing, direct search, ogłoszenia. Wszystko co musisz wiedzieć – kompleksowy poradnik RODO w rekrutacji z naciskiem na działania typu direct search / sourcing.

- Wszystko o systemach ATS – poradnik wyboru systemu rekrutacyjnego

Maciej Michalewski

CEO @ Element. Recruitment Automation Software

Ostatnie wpisy:

Element ma API: rekrutacja podłączona do twoich systemów

Element ma publiczne API w wersji v1-beta. Pokazuję, co integracje dają klientom systemu rekrutacyjnego, jakie błędy popełniłem i czego mnie nauczyły.

Rekrutacja na telefonie: Element jest już mobilny dzięki AI

Mobilne widoki Elementu są na produkcji. Rekruterzy i hiring managerowie prowadzą proces ze smartfona, a 15 000 linii kodu napisało AI w pięć tygodni.

Otrzymujesz email od AI zamiast od człowieka – problem?

Email od AI to nic złego, o ile dane są dobrej jakości. Większość rutynowych zadań ma charakter algorytmiczny, a wynik liczy się bardziej niż autorstwo wiadomości.

Raport ofert pracy, kwiecień 2026: rynek odbija od dna

W kwietniu 2026 pojawiło się 265 tys. ofert pracy w Polsce, spadek tylko o 1% r/r jest najmniejszy od 10 miesięcy. Pobierz LXXI edycję raportu GT i Element.

AI nie zabiera pracy, twierdzi a16z. Co na to polski rynek

David George z a16z dowodzi, że apokalipsa AI to fantazja. Konfrontuję jego argumenty z polskimi danymi i moimi wcześniejszymi tezami.

Integracja Element z LinkedIn uruchomiona, podsumowanie projektu

LinkedIn zaakceptował publiczny feed XML Elementu, w pełni zbudowany w trybie vibe coding z Claude Code. Co z tego wynika dla osób, które nie kodują.